.svg)

En mai 2023, un cabinet d’avocats new-yorkais a soumis au juge un mémoire contenant six décisions de justice générées par ChatGPT. Le problème, c’est qu’aucune de ces décisions n’existait. L’IA les avait fabriquées de toutes pièces, avec de vrais noms de juges, de faux numéros de dossier, et une mise en forme parfaitement crédible.

Ce n’est pas un cas isolé. C’est le fonctionnement normal de l’IA générative quand elle atteint les limites de ses connaissances. Et c’est exactement ce qui se passe chaque jour dans des milliers d’entreprises où les collaborateurs utilisent ces outils sans en connaître les limites. Comprendre et maîtriser ce phénomène fait partie des fondamentaux d’une gouvernance IA solide.

Une hallucination de l’IA est une réponse fausse ou inventée, présentée avec assurance comme un fait vérifié. Les modèles de langage prédisent le texte le plus probable, sans vérifier sa véracité. En entreprise, cela peut entraîner des erreurs dans les rapports, les contrats ou les communications clients.

Le mot “hallucination” est trompeur. Il suggère un dysfonctionnement, un bug. En réalité, c’est le fonctionnement même de l’IA générative qui produit ce résultat. Comprendre le mécanisme est la première étape pour s’en protéger.

Un modèle de langage comme ChatGPT ne “sait” rien au sens humain du terme. Il calcule, mot après mot, la suite la plus probable en fonction de ce qui précède. C’est un moteur de prédiction statistique extrêmement sophistiqué, mais qui n’a aucune notion de vrai ou de faux. Quand il n’a pas l’information, il ne s’arrête pas. Il génère la réponse la plus “plausible”, même si elle est entièrement inventée.

C’est le piège majeur. L’IA ne signale jamais son incertitude. Elle ne dit jamais “je ne suis pas sûr” ou “cette information n’est pas vérifiée”. Une réponse fausse et une réponse juste sont formulées exactement de la même façon, avec le même aplomb. En 2024, une étude de la Columbia Journalism School a testé la capacité de ChatGPT à identifier la source de 200 citations issues de la presse. Résultat : l'outil s'est trompé dans plus de 3 cas sur 4, tout en n'exprimant un doute que 7 fois sur 200. En clair, il est aussi confiant quand il a raison que quand il a tort.

Vos équipes n’ont pas besoin de devenir des experts en IA pour repérer les hallucinations. Il suffit de leur apprendre à reconnaître trois schémas récurrents.

L’IA adore les détails. Elle cite des dates, des pourcentages, des noms de rapport avec une précision qui inspire confiance. C’est souvent là que se cache l’hallucination. Si l’IA vous donne un chiffre très précis (“73,2 % des entreprises”) sans que vous puissiez retrouver la source en deux clics, c’est un signal d’alerte. La règle est simple : plus le détail est précis, plus il doit être vérifié.

C’est le cas classique de l’avocat new-yorkais. L’IA cite un rapport, une étude ou un article qui semble réel. Parfois le document existe, mais la citation ou le chiffre attribué est inventé. C’est ce que la recherche appelle une “hallucination de source”. Le réflexe à ancrer dans vos équipes : ne jamais utiliser une source citée par l’IA sans la vérifier. La charte d’utilisation de l’IA de votre entreprise devrait inclure ce point explicitement.

Détecter les hallucinations ne suffit pas. Il faut construire un cadre qui réduit le risque en amont et prévoit une vérification en aval.

Le principe du “hunan in the loop” (humain dans la boucle) est non négociable. Tout contenu généré par l’IA qui sort de votre entreprise (email client, rapport, offre commerciale, publication) doit être relu par un humain compétent sur le sujet. Ce n’est pas de la défiance, c’est de la rigueur professionnelle. Concrètement, cela signifie que l’IA rédige un brouillon, et l’humain valide, corrige et signe.

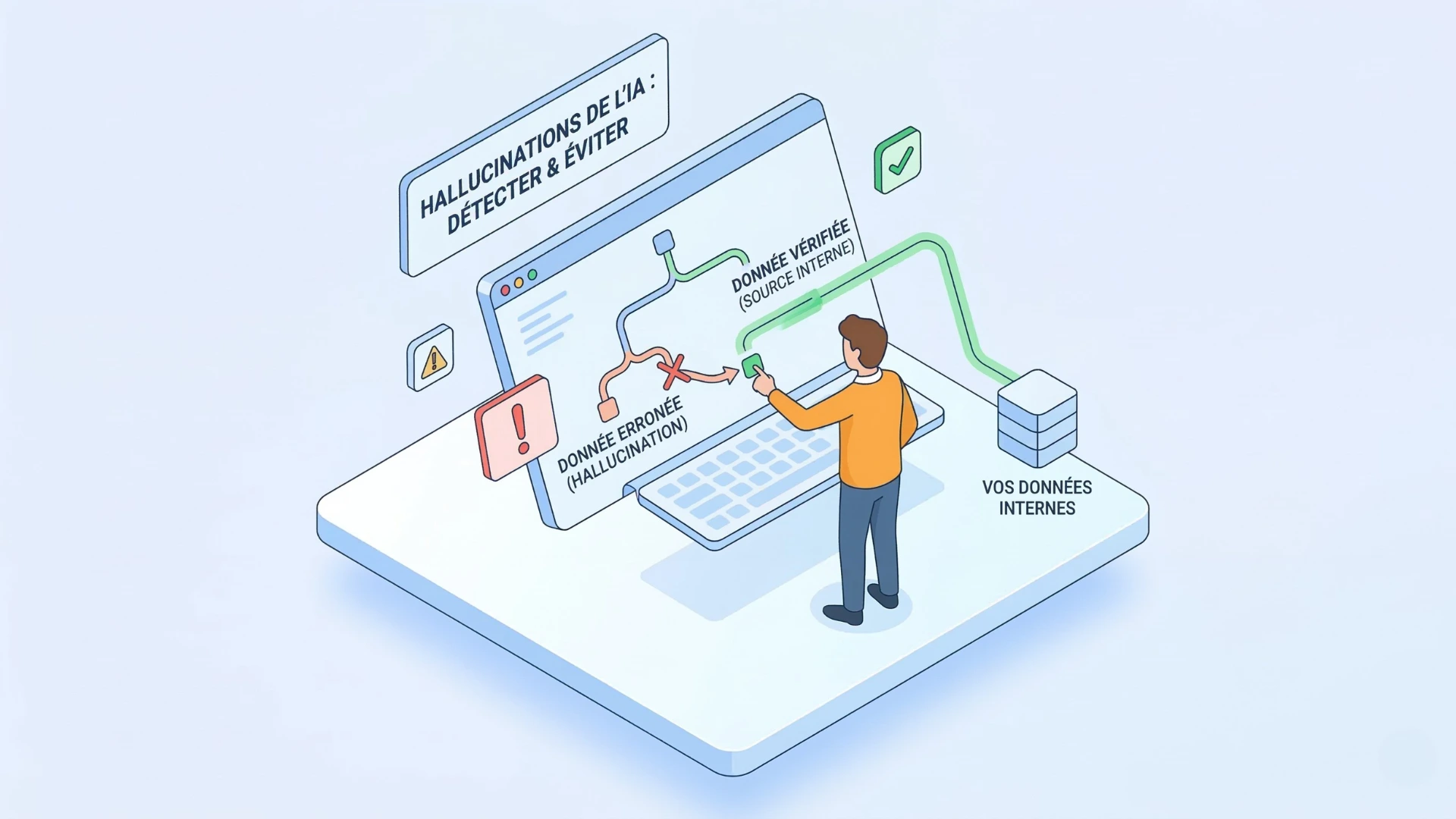

La meilleure façon de réduire les hallucinations est de limiter ce que l’IA doit “deviner”. En lui fournissant vos propres documents comme base de réponse (via une approche RAG), vous contraignez le modèle à s’appuyer sur des faits vérifiés plutôt que sur sa mémoire générale. Ce n’est pas infaillible, mais c’est un progrès considérable. Le principe du RAG est simple : l’IA consulte vos documents internes avant de répondre, au lieu de s’appuyer uniquement sur ses connaissances génériques.

Un outil puissant entre les mains d’une équipe non formée est un risque, pas un atout, d’autant plus quand le Shadow AI se développe dans les services sans supervision. La formation ne doit pas se limiter à “comment utiliser ChatGPT”. Elle doit inclure la compréhension des limites de l’IA, la détection des hallucinations et les bonnes pratiques de vérification. C’est exactement ce que couvre un cadrage de projet IA bien structuré : identifier les usages, former les équipes et poser les garde-fous avant de généraliser.

Pour éviter les hallucinations de l’IA en entreprise, trois réflexes sont essentiels : valider humainement avant toute diffusion, connecter l’IA aux documents internes via le RAG et former les équipes à détecter les signaux d’alerte comme les chiffres invérifiables ou les sources fictives.

Les hallucinations ne sont pas un bug qu’une mise à jour va corriger. Elles sont inhérentes au fonctionnement de l’IA générative. La bonne nouvelle, c’est que des réflexes simples permettent de réduire le risque à un niveau acceptable. La mauvaise nouvelle, c’est que sans formation et sans gouvernance IA structurée, vos équipes ne les appliqueront pas.

Vous souhaitez former vos équipes à utiliser l’IA en toute sécurité, en maîtrisant les risques d’hallucination ?

Notre cadrage de projet IA permet d’évaluer vos usages, de poser les bons garde-fous et de construire un parcours de formation adapté.

Expliquez-nous vos objectifs, nous vous guiderons vers la formation IA la plus adaptée.

.svg)

Formations IA concrètes et accompagnement sur mesure pour les entreprises françaises.

Déclaration d'activité enregistrée sous le numéro 11757544075 auprès du préfet de région d'Île-de-France. Cet enregistrement ne vaut pas agrément d'État.