.svg)

Il y a encore deux ans, l’adoption de l’IA ressemblait au Far West. Chacun testait des outils dans son coin, émerveillé par la technologie mais inconscient des risques. En 2026, la fête est finie. Ou plutôt, elle devient sérieuse.

Avec l’entrée en application progressive de l’IA Act européen et la multiplication des incidents de sécurité liés aux données, la gouvernance IA en entreprise n’est plus un concept flou pour grands groupes du CAC40. C’est un impératif de survie pour toute PME ou ETI. Une étude récente montre d'ailleurs que 60% des fuites de données en entreprise proviennent désormais d'erreurs humaines ou d'outils non validés par la DSI.

Mais rassurez-vous. Gouverner l’IA ne signifie pas créer une "usine à gaz" administrative qui étouffe la créativité. C’est l’inverse. C’est poser des rails de sécurité solides pour permettre à votre train d’aller plus vite. Chez Bloom, nous voyons trop de dirigeants tétanisés par le risque juridique au point de bloquer toute innovation.

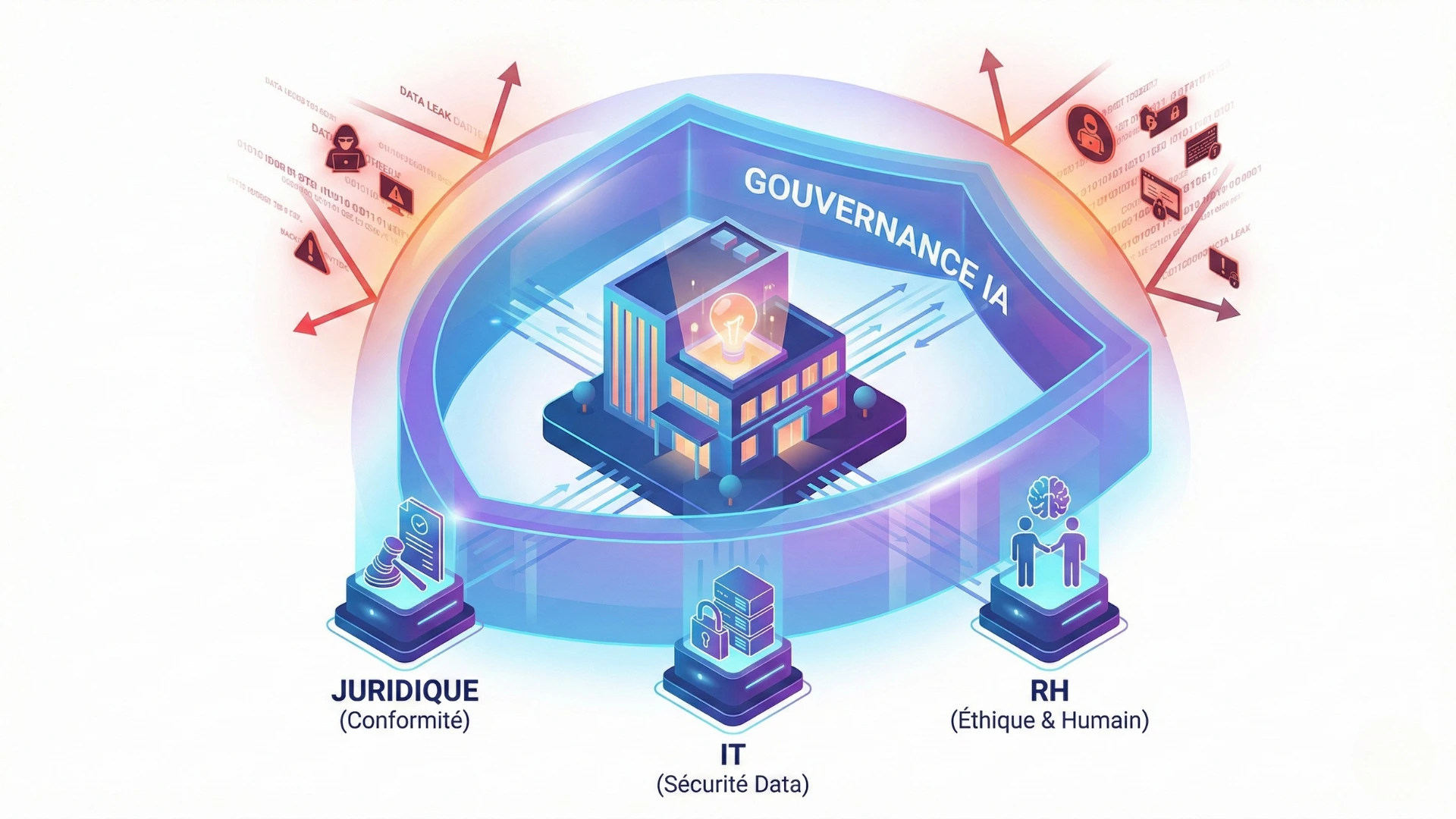

Ce guide complet est là pour démystifier la gouvernance IA. Nous allons voir comment sécuriser votre activité sur trois fronts : juridique, informatique et humain.

La gouvernance IA en entreprise désigne l'ensemble des cadres, politiques et processus mis en place pour garantir un usage de l'intelligence artificielle conforme à la loi (IA Act), éthique et sécurisé. L'objectif n'est pas de freiner l'innovation, mais de maîtriser les risques liés à la confidentialité des données (Shadow AI), aux biais algorithmiques et à la responsabilité juridique, afin de déployer l'IA de manière pérenne et rentable.

L’Europe a été pionnière avec l’IA Act. Si le texte complet est dense, ses implications pour une PME sont souvent plus simples qu’on ne le croit. L’objectif du législateur est de classifier les usages selon leur niveau de risque pour protéger les citoyens sans tuer l'innovation.

Avant même de parler de risques élevés, il existe une règle d'or applicable à presque toutes les PME : le principe de transparence. L'IA Act impose que les utilisateurs sachent quand ils interagissent avec une machine.

Concrètement, si vous utilisez un chatbot pour votre service client ou une IA pour générer des contenus marketing, vous ne pouvez pas laisser planer le doute.

Cette obligation, loin d'être une contrainte, renforce la confiance avec vos clients et partenaires.

C'est la grande peur des dirigeants. Pourtant, la majorité des cas d’usage en PME (aide à la rédaction, synthèse de réunions, génération de code) tombent dans les catégories à risque limité.

En revanche, la vigilance est de mise si vous touchez aux droits fondamentaux des personnes. Vous entrez dans la zone "Haut Risque" si vous utilisez l’IA pour :

Dans ces cas précis, les obligations deviennent strictes : contrôle humain obligatoire, traçabilité des données d’entraînement et documentation technique (Logs) à fournir en cas de contrôle. C'est un paramètre essentiel à prendre en compte. Pour savoir précisément où vous vous situez entre risque "minimal" et "haut risque", nous avons préparé une checklist de conformité IA Act pour PME détaillée. Cela vous permettra d'anticiper les échéances de 2026 sans stress.

C’est le cauchemar des DSI (Directeurs des Systèmes d’Information) et des responsables sécurité. Le Shadow AI désigne l’utilisation d’outils d’IA par vos salariés sans l’accord, la visibilité ou le contrôle de l’entreprise.

Ils ne sont pas malveillants ni saboteurs. Ils cherchent simplement à être efficaces et à supprimer les tâches rébarbatives. Si vous ne leur fournissez pas une version "Entreprise" de ChatGPT, Claude ou Copilot, ils utiliseront la version gratuite et publique avec leur email personnel (Gmail, Yahoo, etc.). Le besoin d'efficacité prime souvent sur la conscience de la sécurité.

Le problème des versions publiques gratuites est simple et contractuel. Si vos équipes utilisent ces outils sans contrôle, vous vous exposez à des risques Shadow AI majeurs (fuite de propriété intellectuelle, non-conformité RGPD) que nous détaillons dans notre article dédié aux usages cachés de ChatGPT.

Imaginez un commercial qui copie-colle votre grille tarifaire 2027 ou un ingénieur qui colle un bout de code propriétaire dans un outil public pour "l’améliorer". Ces informations confidentielles sont ingérées par le modèle et peuvent potentiellement ressortir dans les réponses de l’IA chez un concurrent ou un utilisateur tiers.

La solution technique en deux temps :

La technologie n’est que 20% de l’équation. Les 80% restants, ce sont vos équipes. Une gouvernance solide doit anticiper l’impact humain et nécessite d'investir massivement dans l'acculturation IA de vos collaborateurs.

L’IA hallucine. Elle peut inventer des faits, des chiffres ou des jurisprudences avec un aplomb déconcertant. Une règle de gouvernance absolue doit être : "L’IA propose, l’humain dispose."

Aucun contenu marketing, aucun code logiciel, aucune décision stratégique générée par l’IA ne doit sortir de l’entreprise sans validation humaine explicite. C’est ce qui vous protège juridiquement (responsabilité éditoriale) et commercialement (image de marque).

L'introduction de l'IA peut créer un climat de méfiance. "Est-ce que l'IA va surveiller ma productivité ?" "Est-ce qu'elle va analyser mes emails ?".

Sur ce point, la gouvernance doit être rassurante et ferme. L'IA ne doit pas devenir un outil de "flicage". Le RGPD et le droit du travail s'appliquent toujours : toute mise en place d'outil de monitoring algorithmique doit être discutée avec les représentants du personnel (CSE). Une transparence totale sur l'usage des outils IA rassurera vos équipes et favorisera l'adoption.

Comment passer de la théorie à la pratique ? Voici une feuille de route concrète pour structurer votre démarche dès lundi matin.

Vous ne pouvez pas gouverner ce que vous ne voyez pas. Lancez un sondage anonyme pour savoir quels outils vos équipes utilisent vraiment. Vous serez surpris par la variété et l'ingéniosité des cas d'usage IA déjà présents de manière informelle dans vos services (Marketing, Dev, RH).

Quelles données ne doivent jamais être soumises à une IA, même sécurisée ? (Ex : Données de santé, secrets de fabrique, brevets non déposés, données bancaires clients). Listez-les clairement et communiquez cette liste.

C’est le document de référence. Il doit être court, lisible et signé par les collaborateurs. Il ne s’agit pas d’interdire, mais de préciser les conditions d’usage (ex: "Interdiction d'utiliser des données personnelles clients dans les prompts", "Toujours vérifier les sources").

C’est un investissement nécessaire. Payer 25€/mois par utilisateur pour une licence sécurisée coûte bien moins cher qu’une fuite de données stratégiques ou une perte de réputation. N'oubliez pas qu'il existe des solutions pour financer sa stratégie IA via des aides publiques comme le FSE+ ou les diagnostics Bpifrance.

Une gouvernance sans formation est inutile. Vos collaborateurs doivent comprendre pourquoi certaines règles existent, sinon ils les contourneront. C’est là que Bloom intervient : nous transformons vos règles de gouvernance en réflexes opérationnels grâce à des formations sur-mesure et des ateliers pratiques.

Pour sécuriser l'usage de l'IA en entreprise, les dirigeants doivent suivre 5 étapes clés : auditer les pratiques actuelles (Shadow AI), définir les données sensibles à exclure, rédiger une charte d'utilisation éthique, investir dans des licences logicielles sécurisées (non-entraînement des données) et former les collaborateurs aux risques d'hallucination et de biais.

La gouvernance IA entreprise n’est pas un frein, c’est votre ceinture de sécurité. Elle vous permet d’appuyer sur l’accélérateur en toute confiance sur l'autoroute de l'innovation.

En 2026, les entreprises qui gagneront ne seront pas celles qui interdisent l’IA par peur, ni celles qui l’utilisent n’importe comment. Ce seront celles qui auront construit un cadre clair où l’innovation peut s’épanouir sans mettre en péril la maison. Ne laissez pas le juridique dicter votre stratégie, mais faites-en un allié de votre croissance.

Vous voulez sécuriser vos pratiques sans brider vos équipes ?

Chez Bloom, nous intégrons systématiquement le volet "Bonnes pratiques et Sécurité" dans nos formations métiers pour rendre vos équipes autonomes et responsables. Discutons de votre contexte lors d'un call de cadrage dédié.

Expliquez-nous vos objectifs, nous vous guiderons vers la formation IA la plus adaptée.

.svg)

Formations IA concrètes et accompagnement sur mesure pour les entreprises françaises.

Déclaration d'activité enregistrée sous le numéro 11757544075 auprès du préfet de région d'Île-de-France. Cet enregistrement ne vaut pas agrément d'État.