.svg)

Quand on parle de l’IA Act, la plupart des dirigeants ont deux réactions possibles. La première : « ça ne me concerne pas, je n’ai pas développé d’IA ». La seconde : « ça va être un cauchemar administratif comme le RGPD ». Les deux sont fausses.

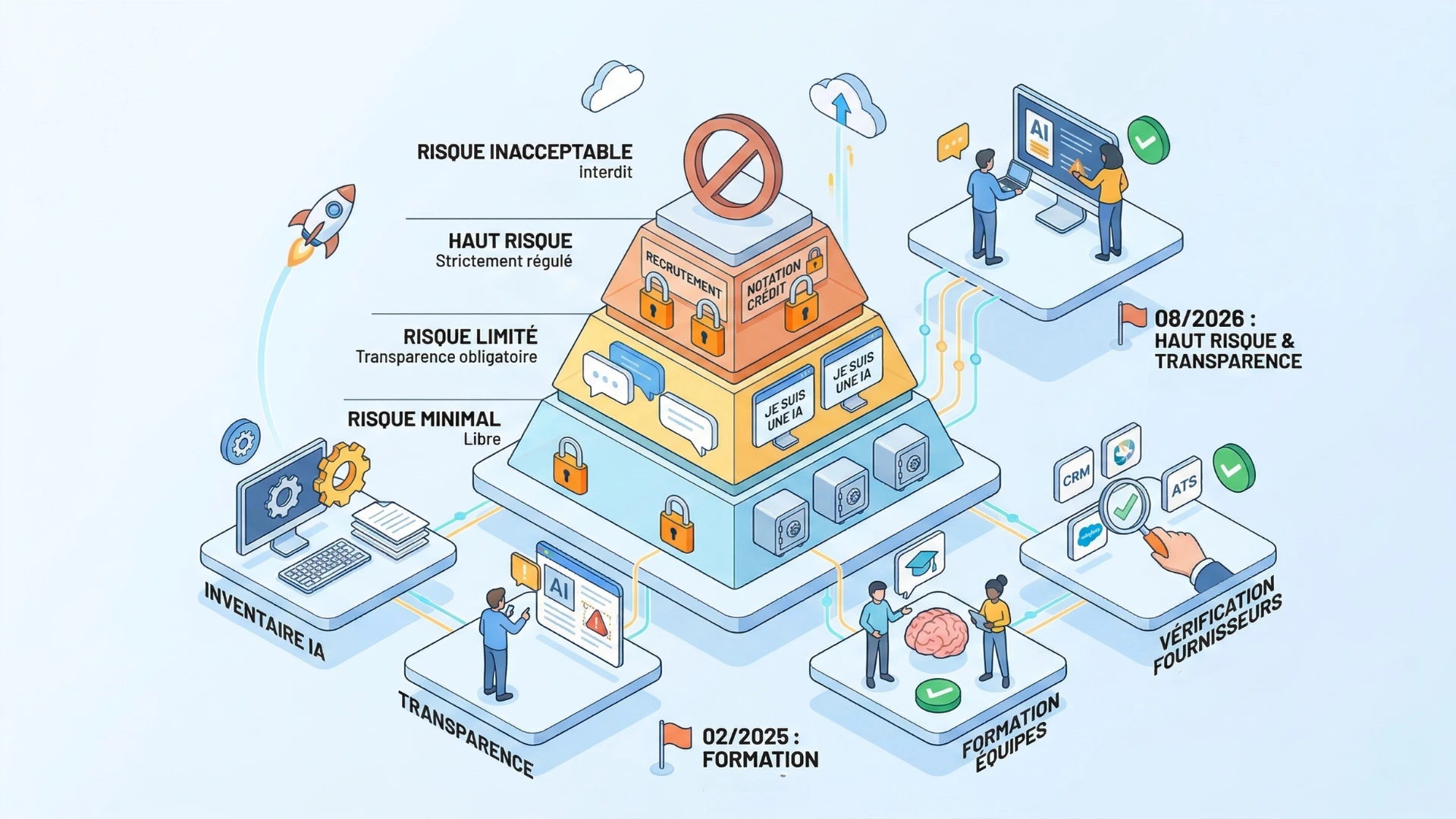

L’IA Act (règlement UE 2024/1689) est entré en vigueur le 1er août 2024 et son application est progressive. Les interdictions et l’obligation de formation des équipes sont déjà applicables depuis le 2 février 2025. Le gros morceau, c’est le 2 août 2026 : application complète pour les systèmes à haut risque et les obligations de transparence (source : Commission européenne).

Contrairement au RGPD qui s’applique à tous les traitements de données, l’IA Act fonctionne par approche par les risques. Plus l’usage est sensible, plus les obligations sont lourdes. Pour la majorité des entreprises, les obligations sont gérables. Mais encore faut-il savoir où vous vous situez.

L’IA Act (règlement UE 2024/1689) encadre l’utilisation de l’intelligence artificielle selon quatre niveaux de risque. Il s’applique à toute entreprise qui développe (fournisseur) ou utilise (déployeur) un système d’IA. L’application complète intervient le 2 août 2026 pour le haut risque et les obligations de transparence.

C’est LA question à vous poser en priorité. L’IA Act distingue plusieurs rôles dans la chaîne de valeur, mais deux concernent la majorité des entreprises.

Vous êtes fournisseur si vous concevez, entraînez ou mettez sur le marché un système d’IA, même pour un usage interne. C’est le cas si vous développez une application propriétaire qui intègre un modèle d’IA, ou si vous commercialisez un logiciel basé sur l’IA. Les obligations sont lourdes : documentation technique, évaluation de conformité, marquage CE pour le haut risque.

Pour 95 % des entreprises, vous n’êtes pas fournisseur. Vous n’avez pas entraîné GPT ou Mistral. Vous utilisez des outils existants.

C’est le piège dans lequel tombent beaucoup de dirigeants. Vous êtes déployeur dès que vous utilisez un outil IA dans un cadre professionnel, même acheté sur étagère. Vous utilisez ChatGPT pour rédiger des emails ? Déployeur. Votre équipe RH utilise un logiciel de tri de CV basé sur l’IA ? Déployeur. Vous avez installé un chatbot sur votre site ? Déployeur.

La bonne nouvelle, c’est que les obligations du déployeur sont beaucoup plus légères que celles du fournisseur. La mauvaise nouvelle, c’est qu’elles existent et qu’elles sont vérifiables. Ignorer cette distinction expose votre entreprise à des contrôles et des sanctions.

L’IA Act classe les systèmes selon leur impact potentiel. Plus le risque est élevé, plus les obligations sont strictes.

Les systèmes à risque inacceptable sont purement et simplement interdits depuis février 2025 : notation sociale, manipulation subliminale, reconnaissance faciale en temps réel dans l’espace public. Aucune entreprise classique n’est concernée dans la vraie vie.

Le haut risque est beaucoup plus piegeux. Vous êtes concerné si vous utilisez l’IA dans des domaines sensibles comme :

Si votre logiciel RH trie automatiquement les CV, même s’il est fourni par un éditeur tiers, votre entreprise est soumise aux obligations haut risque à partir du 2 août 2026. C’est précisément là qu’une vraie gouvernance IA devient indispensable pour cadrer les responsabilités.

Pour la majorité des entreprises, les usages courants relèvent du risque limité ou minimal. Utiliser ChatGPT pour rédiger un email, générer une image avec Midjourney, résumer une réunion avec un assistant IA : ce sont des usages à risque limité.

L’obligation principale est la transparence : signaler aux utilisateurs qu’ils interagissent avec une IA (chatbot) ou qu’un contenu a été généré par IA (image, voix synthétique). C’est une obligation simple, mais qu’il faut réellement mettre en place. La plupart des entreprises la négligent.

Si vous êtes déployeur sur des usages à risque limité (le cas le plus fréquent), voici les quatre actions à mener.

C’est l’obligation la plus ignorée, alors qu’elle est déjà applicable depuis le 2 février 2025. L’article 4 du règlement impose à toute entreprise qui déploie un système d’IA de garantir un niveau suffisant de « littératie IA » à ses collaborateurs. Concrètement, vos équipes doivent comprendre comment fonctionnent les outils qu’elles utilisent, quels sont leurs limites et leurs risques.

Ce n’est pas une option. C’est une obligation légale qui s’applique aujourd’hui, même pour une entreprise de 15 personnes. C’est pour cette raison que former ses équipes à l’IA est devenu un sujet de conformité et plus seulement de productivité.

Si vous avez un chatbot sur votre site, ajoutez la mention « Je suis un assistant virtuel piloté par une IA ». Si vous publiez des contenus générés par IA (images, voix synthétiques), signalez-le clairement. Cette obligation devient pleinement applicable le 2 août 2026, mais il est préférable de l’anticiper.

Faites la liste de tous les outils IA utilisés dans votre entreprise, y compris ceux utilisés en dehors des circuits officiels. Ce que l’on appelle le Shadow AI (l’usage non déclaré d’outils IA par les équipes) est le point faible principal de la conformité. Vous ne pouvez pas conformer ce que vous ne connaissez pas.

Ensuite, interrogez vos éditeurs de logiciels (CRM, ATS, ERP) : « votre module IA est-il conforme à l’IA Act ? ». Exigez une réponse écrite, surtout si l’outil touche aux RH, aux finances ou à la notation client. Cette vigilance est essentielle car en tant que déployeur, vous restez responsable de l’usage que vous faites de l’outil.

Une charte IA interne est le document qui rassemble vos règles d’usage et protège votre entreprise. Elle définit les outils autorisés, les données interdites de saisie, l’obligation de vérification humaine et le référent IA. Ce n’est pas une obligation formelle de l’IA Act, mais c’est l’outil opérationnel qui traduit ses exigences en pratiques quotidiennes.

La question que tout dirigeant se pose : qu’est-ce que je risque vraiment ?

Les sanctions sont graduées selon la nature de la non-conformité (source : info.gouv.fr) :

Pour les PME et startups, le règlement prévoit des plafonds proportionnels réduits (article 99). L’enjeu n’est donc pas une amende à sept chiffres, mais plutôt le risque opérationnel : un système non conforme peut être interdit d’exploitation sur le marché européen.

En France, trois autorités sont désignées pour le contrôle et l’application de l’IA Act : la CNIL (protection des données et IA), la DGCCRF (répression des fraudes) et l’Arcom (régulation audiovisuelle et numérique). La CNIL a déjà annoncé qu’elle intensifierait ses contrôles sur les systèmes RH à partir de l’automne 2026.

Les entreprises qui utilisent des outils d’IA sont qualifiées de déployeurs par l’IA Act. Leurs obligations : former les équipes (en vigueur depuis février 2025), assurer la transparence vis-à-vis des utilisateurs, inventorier les outils et vérifier la conformité des fournisseurs avant le 2 août 2026.

L’IA Act n’est pas un frein à l’innovation. C’est un cadre qui vous oblige à structurer ce que vous faites déjà. Les entreprises qui anticipent la conformité en 2026 transforment cette contrainte en argument commercial : dans un marché où la confiance devient rare, afficher une IA maîtrisée et transparente rassure vos grands donneurs d’ordre et vos clients finaux.

Au-delà de la conformité pure, c’est l’occasion de cadrer une véritable stratégie IA alignée sur vos objectifs business, plutôt que de subir les usages non contrôlés.

Vous avez un doute sur votre statut (déployeur ou fournisseur) ou sur la classification de vos outils ?

Expliquez-nous vos objectifs, nous vous guiderons vers la formation IA la plus adaptée.

.svg)

Formations IA concrètes et accompagnement sur mesure pour les entreprises françaises.

Déclaration d'activité enregistrée sous le numéro 11757544075 auprès du préfet de région d'Île-de-France. Cet enregistrement ne vaut pas agrément d'État.