.svg)

91 % des cyberattaques réussies commencent par un email frauduleux (source : rapport ANSSI 2025). Ce chiffre n’a pas changé depuis des années. Ce qui a changé, c’est la qualité de ces emails. Grâce à l’IA générative, un attaquant peut désormais rédiger un message d’hameçonnage parfaitement personnalisé, sans faute d’orthographe, en imitant le ton exact d’un fournisseur ou d’un collègue.

La cybersécurité n’est plus un sujet réservé aux DSI. C’est un enjeu qui concerne chaque collaborateur qui utilise l’IA au quotidien. Et pour les entreprises qui n’ont pas de service informatique dédié, c’est un sujet d’autant plus critique.

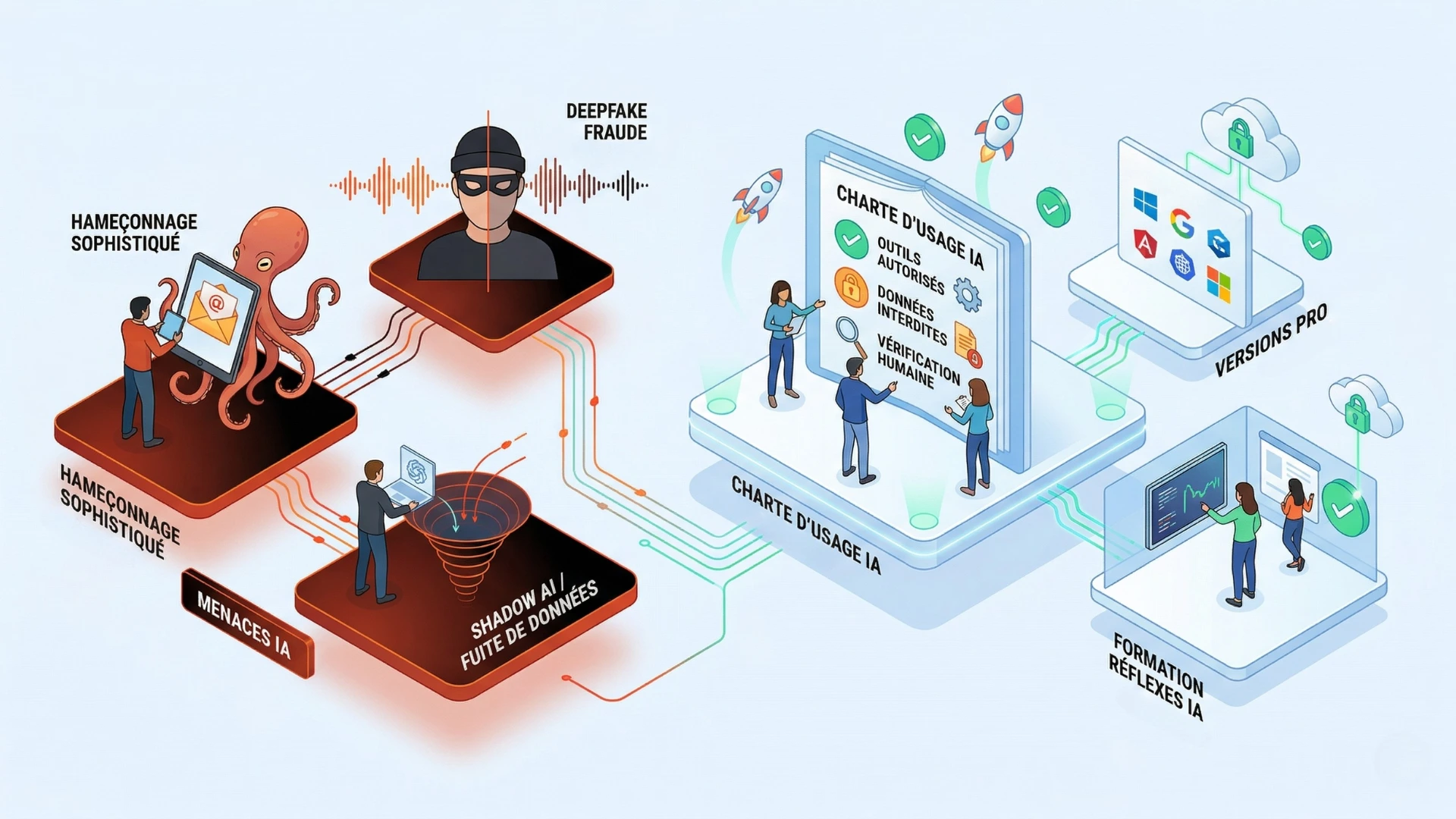

L’IA amplifie les cybermenaces de trois façons : un hameçonnage plus crédible grâce à la personnalisation automatique, des deepfakes audio et vidéo pour usurper des identités, et un risque de fuite de données lorsque des collaborateurs utilisent des outils d’IA publics non sécurisés.

L’IA n’a pas inventé de nouvelles cyberattaques. Elle a rendu les attaques existantes plus redoutables. Voici les trois menaces concrètes que vos équipes vont rencontrer.

Avant l’IA, un email d’hameçonnage était souvent repérable : fautes d’orthographe, formulations génériques, expéditeur suspect. Aujourd’hui, un attaquant utilise l’IA pour rédiger un email parfait, adapté à votre secteur, à votre entreprise, voire à un projet en cours. Il peut même analyser vos communications publiques (site web, LinkedIn) pour imiter le style d’un dirigeant ou d’un partenaire commercial. Ce niveau de personnalisation rend la détection beaucoup plus difficile pour vos collaborateurs.

L’IA permet désormais de cloner une voix en quelques secondes d’échantillon audio. Un attaquant peut simuler un appel téléphonique d’un dirigeant demandant un virement urgent, ou créer une vidéoconférence truquée pour valider une transaction. Ces scénarios, autrefois de la science-fiction, sont désormais documentés. La parade n’est pas technique, elle est organisationnelle : toujours vérifier par un second canal avant d’exécuter un ordre sensible.

C’est la menace la plus sous-estimée. Quand un collaborateur copie-colle un contrat client, des chiffres financiers ou des données RH dans ChatGPT ou un outil d’IA gratuit, ces données peuvent être utilisées pour entraîner le modèle. C’est exactement le phénomène du Shadow AI : l’utilisation non encadrée d’outils d’IA par les équipes, en dehors de tout cadre de sécurité. La solution n’est pas d’interdire l’IA, mais de l’encadrer.

La bonne nouvelle, c’est que les mesures de protection les plus efficaces ne sont ni coûteuses ni techniques. Elles reposent sur trois piliers : les règles, les outils et la formation.

C’est le premier geste à poser. Une charte d’utilisation de l’IA définit ce que vos équipes ont le droit de faire et ce qui est interdit : quelles données peuvent être partagées avec un outil d’IA, quels outils sont autorisés, quelles sont les procédures de vérification pour les demandes sensibles. Cette charte doit être simple, diffusée à tous, et révisée régulièrement.

ChatGPT Enterprise, Copilot 365, Mistral Business : ces versions garantissent que vos données ne sont pas utilisées pour l’entraînement du modèle et offrent des contrôles d’accès. Le surcoût par rapport aux versions gratuites est dérisoire comparé au risque d’une fuite de données. C’est aussi une exigence de conformité avec le RGPD appliqué à l’IA : les données personnelles de vos clients ne doivent jamais transiter par un outil non sécurisé.

La technologie évolue, les réflexes doivent suivre. Vos collaborateurs savent (peut-être) repérer un email suspect classique. Mais savent-ils détecter un hameçonnage généré par l’IA ? Savent-ils qu’il ne faut jamais copier de données confidentielles dans un outil d’IA publique ? Ces réflexes s’enseignent. C’est l’un des volets clés de toute démarche d’acculturation IA en entreprise : comprendre les risques pour mieux utiliser les outils.

Pour protéger son entreprise des risques cyber liés à l’IA, trois actions prioritaires sont recommandées : mettre en place une charte d’utilisation de l’IA, utiliser les versions professionnelles des outils (ChatGPT Enterprise, Copilot, Mistral Business) et former les équipes aux nouveaux risques comme l’hameçonnage augmenté et les deepfakes.

Les outils de protection les plus sophistiqués ne servent à rien si vos équipes ne sont pas formées aux nouveaux risques. Dans un monde où l’IA rend les attaques plus crédibles et les fuites plus faciles, la première défense reste humaine. C’est aussi pourquoi la gouvernance IA ne peut pas être traitée comme un sujet à part : cybersécurité, conformité et formation sont les trois faces d’un même enjeu.

Vous voulez former vos équipes aux bons réflexes de cybersécurité liés à l’IA ?

Notre cadrage de projet IA intègre systématiquement un volet sécurité et conformité adapté à vos usages.

Expliquez-nous vos objectifs, nous vous guiderons vers la formation IA la plus adaptée.

.svg)

Formations IA concrètes et accompagnement sur mesure pour les entreprises françaises.

Déclaration d'activité enregistrée sous le numéro 11757544075 auprès du préfet de région d'Île-de-France. Cet enregistrement ne vaut pas agrément d'État.